Wie wirken sich KI-Bilder auf unser Selbstbild aus? Die britische Wissenschaftlerin Aisha Sobey zeigt in einer neuen Studie, wie Bildgeneratoren Schönheitsideale verstärken und unser Verständnis von Normalität nachhaltig prägen.

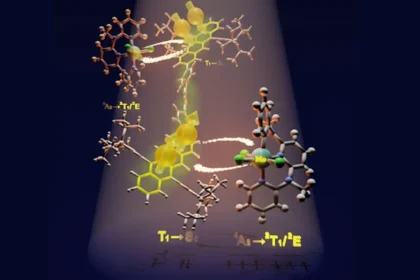

Schon längst nutzen Menschen Künstliche Intelligenz (KI) nicht mehr ausschließlich, um Texte zu erstellen. Mithilfe von Modellen wie Dall-E, Midjourney oder Stable Diffusion kann nahezu jeder eindrucksvolle und vor allem echt wirkende Bilder generieren.

Sie sind teilweise schwer von menschengemachten Bildern zu unterscheiden. Das hat ungeahnte Folgen, besonders wenn es um die Darstellung von Menschen geht.

Selbstbild: So stellt KI-Bilder Schönheitsideale dar

KI-generierte Personen wirken häufig überproportional schön, schlank, glatt und makellos. Vielfalt in Alter, Körperform, Hautfarben und Geschlechtsidentitäten fehlen oft. Der dauerhafte Konsum solcher Bilder kann unserem Selbstbild schaden und das Selbstbewusstsein schwächen – besonders bei jungen Menschen.

Auch Wissenschaftlerin Aisha Sobey kritisiert, dass KI bestehende Schönheitsideale verstärkt statt hinterfragt. Am Leverhulme Center for the Future of Intelligence der University of Cambridge untersucht sie, wie generative KI-Bildmodelle gesellschaftliche Normen und Schönheitsideale reproduzieren und beeinflussen.

In ihrer Arbeit beschäftigt sich die Forscherin vor allem damit, wie wir und die KI Körpergrößen und Körperformen wahrnehmen. Dazu analysierte sie in einer Studie 649 KI-generierte Bilder verschiedener Modelle.

„Menschen, die etwas anders sind als in unserer kollektiven Vorstellung, werden effektiv ausgelöscht.“

Die Studienergebnisse zeigen, dass KI-Modelle kaum Bilder mit „größeren Körpertypen“ generiert, es sei denn, man fragt ausdrücklich danach. Auch Körper, die außerhalb der sogenannten „Straight Size“ liegen, werden nicht ohne detaillierte Anweisung erstellt.

Fordert man die KI allerdings mit einem entsprechenden Prompt auf, „größere Körper“ zu generieren, haben die dargestellten Personen selten positive Gesichtsausdrücke, weisen häufige Fehler oder Anomalien auf und erscheinen auch insgesamt weniger freundlich oder idealisiert, als Personen mit schlankeren Körperformen.

„Wenn man eine generative KI nach einer Person fragt, zeigt keines der neun Modelle, die ich getestet habe, unaufgefordert einen behinderten oder dicken Körper“, so Sobey in einem Interview mit der Deutschen Welle. „Menschen, die etwas anders sind als in unserer kollektiven Vorstellung, werden effektiv ausgelöscht.“

Datensatz für KI-Bilder basiert auf Pornografie

Grund dafür sind die Datenbanken, mit denen die KI-Modelle trainiert werden. „Die Grundlage der meisten dieser Modelle ist der LAION 5B-Datensatz“, erklärte Sobey in einem Vortrag auf dem „Re:publica25“-Festival in Berlin.

Dieser [Datensatz] besteht aus Daten, die aus dem Internet zusammengetragen wurden, oft gegen Urheberrechte und Eigentumsrechte von Künstlern. Wenn man darüber nachdenkt, was aktuell im Internet zu finden ist, wissen wir, dass es überwiegend westlich geprägt, überwiegend weiß und hauptsächlich aus Menschen besteht, die ihr bestes Leben leben und versuchen zu demonstrieren, dass ihr Leben gut ist.

Glaube man allerdings den Statistiken, so Sobey, besteht dieser Datensatz zu etwa 18 bis 20 Prozent aus Pornografie. Bildet das die Basis für generative KI, dürfte es kaum verwundern, dass die Ergebnisse wenig Diversität zeigen.

So stören KI-Bilder das Selbstbild

Dass viele Körperformen auf diese Weise Art dargestellt werden, hat Auswirkungen auf unsere Selbstwahrnehmung. Sobey mache die Darstellung nicht normkonformer Körper durch die KI betroffen.

„Die Stimmung, die Farben, die Gesichtsausdrücke. Die Körperformen und die Kleidung werden alle viel weniger ausgefeilt und viel weniger schön dargestellt. Sie wirken oft irgendwie traurig.“

Ihrer Ansicht nach spiegelt das die Art der verarbeiteten Daten wieder und es zeigt, wie wir als Gesellschaft Menschen mit „größeren Körpern“ sehen. Gesellschaftliche Vorurteile und mangelnde Diversität spiegeln sich in den Ergebnissen der KI-Anfragen wieder. Sie formen laut Sobey gleichzeitig die gesellschaftliche Macht und Erwartungen, indem sie uns zeigen, was wir als „normal“ empfinden sollen.

Wenn wir diese Idealvorstellung von Personen haben, die nicht mit dem übereinstimmt, wer und was wir sind, kann das zu Unzufriedenheit führen und dass Menschen sich selbst negativ sehen. Ich glaube, das führt dazu, dass Probleme mit dem Körperbild, Essstörungen und Esssucht deutlich zunehmen. Und das ist nicht nur die Schuld der generativen KI, aber sie trägt zusätzlich zu dieser Belastung bei.

So könnten KI-Bilder künftig diverser werden

Bereits in der Vergangenheit versuchten Studien und Projekte zu zeigen, wie KI-Bildgeneratoren Stereotypen über verschiedene Länder und Kulturen verstärken. Genau wie Alicia Sobey fordern sie, gesellschaftliche Verantwortung zu übernehmen.

Plattformen und Entwickler sollten mehr Diversität in ihre Systeme einbauen. Alternative Lösungen könnten Community-basierte, weniger ressourcenintensive KI-Modelle mit Datenhoheit sein.

Allerdings fordert Sobey auch, dass Nutzer kritisch bleiben, KI-Bilder hinterfragen und sich bewusst machen, dass sie keine Realität sind, sondern nur ein technisches Konstrukt zeigen.

Auch interessant: