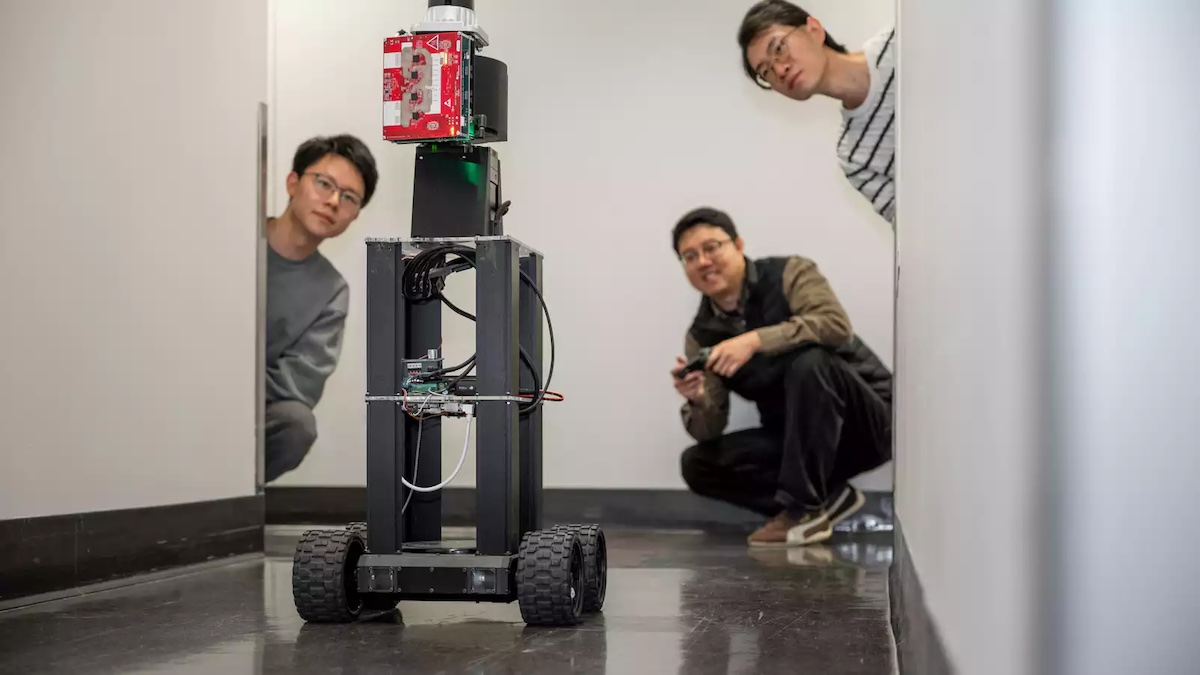

Forscher haben ein sogenanntes HoloRadar entwickelt, das Roboter mittels Funkwellen um Ecken gucken lässt. Ein KI-Modell wertet die Daten aus.

Ein Forscherteam der University of Pennsylvania hat ein System entwickelt, mit dem mobile Roboter Objekte wahrnehmen können, noch bevor diese in das direkte Sichtfeld treten. Die Technologie nutzt ein Radarmodul und eine speziell konzipierte Künstliche Intelligenz, um Hindernisse um Ecken herum erkennen zu können.

Der Roboter identifizierte etwa Fußgänger in einem verwinkelten Flur. Die Forscher beschreiben ihre Ergebnisse in einer Veröffentlichung der Annual Conference on Neural Information Processing Systems. Ihr Roboter tastet seine Umgebung aktiv ab, indem er über das Radarmodul hochfrequente Funksignale aussendet.

Diese Signale treffen auf flache Oberflächen wie Wände, Böden oder Decken und werden von diesen zurückgeworfen. Ein Teil der Wellen breitet sich dabei auch in Bereichen außerhalb des primären Sichtbereichs aus und prallt dort ab. Durch den Empfang dieser Echos erhält das System Informationen über Objekte, zu denen kein direkter Blickkontakt besteht.

Roboter sieht mit HoloRadar um Ecken: KI-Verstand für Funkwellen

Bei der praktischen Umsetzung stößt die herkömmliche Signalverarbeitung jedoch an technische Grenzen. Einzelne Funkimpulse werden auf ihrem Weg durch verwinkelte Räume mehrfach abgelenkt. Der Empfänger des Roboters steht dadurch inmitten eines Gewirrs aus verschiedenen zurückspringenden Funkwellen. Diese Signalüberlagerung macht es Standardsystemen unmöglich, die Informationen sauber zu entflechten.

Die Forscher lösten diese Schwierigkeit mit einer maßgeschneiderten Künstlichen Intelligenz. Die Software kombiniert klassisches maschinelles Lernen mit fundiertem Wissen über physikalische Gesetzmäßigkeiten. Das System verarbeitet Daten in zwei aufeinanderfolgenden Schritten. Zuerst hilft die KI dem Roboter dabei, jene Signale zu identifizieren, die über ganz bestimmte Spiegelungswege zurückgekehrt sind.

Die Software versteht durch diesen Abgleich, welche Umwege die Wellen im Raum genommen haben. In einem zweiten Schritt greift das System erneut auf das hinterlegte physikalische Modell zurück. Es nutzt es, um die genaue Herkunft der zuvor identifizierten, abgelenkten Signale zu berechnen. Auf diese Weise bestimmt der Roboter die Position von Hindernissen hinter einer Sichtbarriere.

Radar sieht, was Kameras nicht blicken

Aus diesen Informationen erstellt der Roboter eine dreidimensionale Rekonstruktion seiner gesamten Umgebung. Diese virtuelle Karte bildet auch Bereiche ab, die ursprünglich außerhalb des Sichtfelds lagen. In der Vergangenheit stellten Fachleute bereits Geräte mit ähnlichen Fähigkeiten vor, die jedoch sichtbares Licht nutzten. Solche Systeme werten Schattenwürfe oder indirekte Reflexionen von Lichtquellen aus.

Ein wesentlicher Nachteil lichtbasierter Methoden ist ihre starke Abhängigkeit von den herrschenden Lichtverhältnissen. Sie benötigen meist eine kontrollierte Beleuchtung, um präzise Daten über verborgene Objekte zu liefern. Ohne eine optimale Lichtquelle verlieren diese Sensoren an Zuverlässigkeit. Das System der University of Pennsylvania arbeitet hingegen ohne eine solche kontrollierte Beleuchtung.

Die Radarwellen benötigen kein sichtbares Licht, um Hindernisse oder Personen hinter Ecken zu erfassen. Dies ermöglicht den Einsatz mobiler Roboter unter realen Bedingungen. Während optische Sensoren in schlecht beleuchteten Umgebungen versagen können, tastet das Radarsystem die Struktur des Raumes kontinuierlich ab. Damit bietet die Technologie eine Lösung für die Navigation in verwinkelten Gebäudestrukturen.

Durch die Kombination von physikalischen Modellen und lernfähigen Algorithmen erreichte die Forschungsgruppe eine veränderte Form der Wahrnehmung. Die Maschine interpretiert die Signalüberlagerung nicht als Störung, sondern nutzt sie zur Lagebestimmung. Personen werden so bereits zu einem Zeitpunkt erkannt, an dem sie für das System bisher nicht direkt sichtbar sind. Dieser technische Ansatz erweitert die Möglichkeiten der räumlichen Bildverarbeitung.

Auch interessant:

- ChatGPT hört mit: So kannst du Hintergrundgespräche deaktivieren

- Elektroauto gebraucht kaufen: Darauf solltest du achten

- Strom durch Schritte: die Zukunft der nachhaltigen Energie?

- KI-Chatbots im Vergleich: Wie gut sind ChatGPT, Gemini und Co. wirklich?