Extremistische Inhalte müssen schneller aus sozialen Netzwerken verschwinden. Diese Forderung der Europäischen Union hat Facebook ernst genommen und im ersten Quartal 2018 fast zwei Millionen Beiträge gelöscht. Außerdem liefert das soziale Netzwerk seine Definition von Terrorismus.

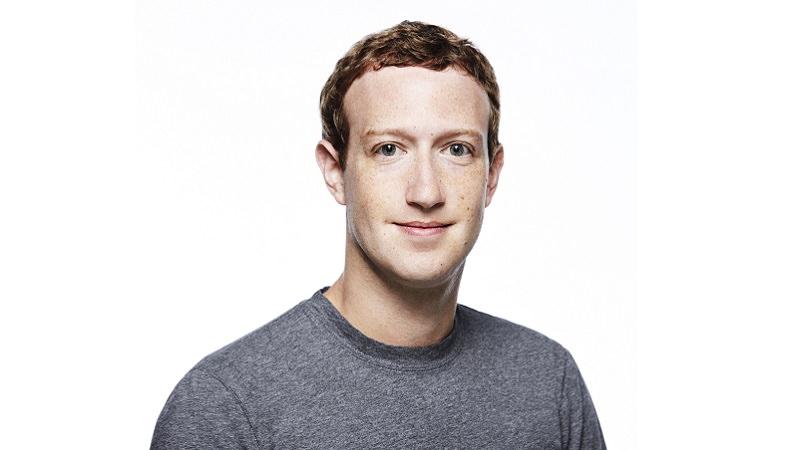

Nachdem sich Facebook während des Cambridge-Analytica-Skandals stets in der Defensive befand, ergreift das soziale Netzwerk nun wieder die Initiative.

In einem Blog-Beitrag äußern sich Monika Bickert, Vice President of Global Policy Management, und Brian Fishman, Global Head of Counterterrorism Policy, zu den Erfolgen des sozialen Netzwerks im Kampf gegen den Terrorismus.

Damit reagiert Facebook auf eine Forderung der Europäischen Union. Diese forderte soziale Netzwerke erst vor kurzem dazu auf, extremistische Beiträge schneller zu löschen. Eine Aufgabe, die für Facebook, Twitter und Co. nicht allzu leicht zu bewältigen ist.

1,9 Millionen terroristische Posts gelöscht

Das Ziel von Facebook sei es, wie die beiden Autoren des Blog-Beitrags mitteilen, Propaganda schnell und effektiv zu entdecken und zu löschen. Dafür gibt es neben einem Algorithmus auch noch eine 200-köpfige Anti-Terrorimus-Einheit. Im Juni 2017 waren es noch 150 Mitarbeiter.

Der Fokus der Terrorismus-Bekämpfer liegt aktuell auf dem Islamischen Staat (IS) und Al-Qaida. In den ersten drei Monaten des Jahres wurden auf Facebook mehr als 1,9 Millionen Inhalte entfernt oder gekennzeichnet, die mit einem der beiden Terrornetzwerke in Verbindung stehen. Das entspricht einer Verdoppelung im Vergleich zum vierten Quartal 2017.

Zwei Technologien, ein Ziel

Eine spannende Information, die Bickert und Fishman verraten haben, ist, dass 99 Prozent der Inhalte nicht von Nutzern gemeldet, sondern von der Facebook-Technologie aufgestöbert worden sind. Dazu rechnet Facebook auch alle Beiträge, die Mitarbeiter des Anti-Terror-Teams identifiziert haben.

Des Weiteren will sich Facebook auch stärker auf bereits existierende extremistische Inhalte konzentrieren. Dafür kommt eine andere Software zum Einsatz, da sich die Anforderungen zu stark unterscheiden.

Im ersten Quartal 2018 wurden auf diesem Weg 600.000 alte Beiträge, die in Verbindung zum Terrorismus stehen, gelöscht. Im Durchschnitt befinden sich diese 970 Tage (2,65 Jahre) auf dem sozialen Netzwerk.

So definiert Facebook Terrorismus

Um besser nachvollziehen zu können, warum welche Inhalte gegebenenfalls als terroristisch eingestuft werden, hat Facebook zudem noch seine Definition von Terrorismus veröffentlicht.

Als Terrorismus werte Facebook „jede Nicht-Regierungsorganisation, die vorsätzliche Gewalthandlungen gegen Personen oder Eigentum betreibe, um eine Zivilbevölkerung, eine Regierung oder internationale Organisation einzuschüchtern, um ein politisches, religiöses oder ideologisches Ziel zu erreichen.“

Von dieser Definition ausgenommen sind Regierungen. Der Grund dafür ist laut Facebook, dass es für Staaten unter bestimmten Umständen legitim ist, Gewalt anzuwenden.