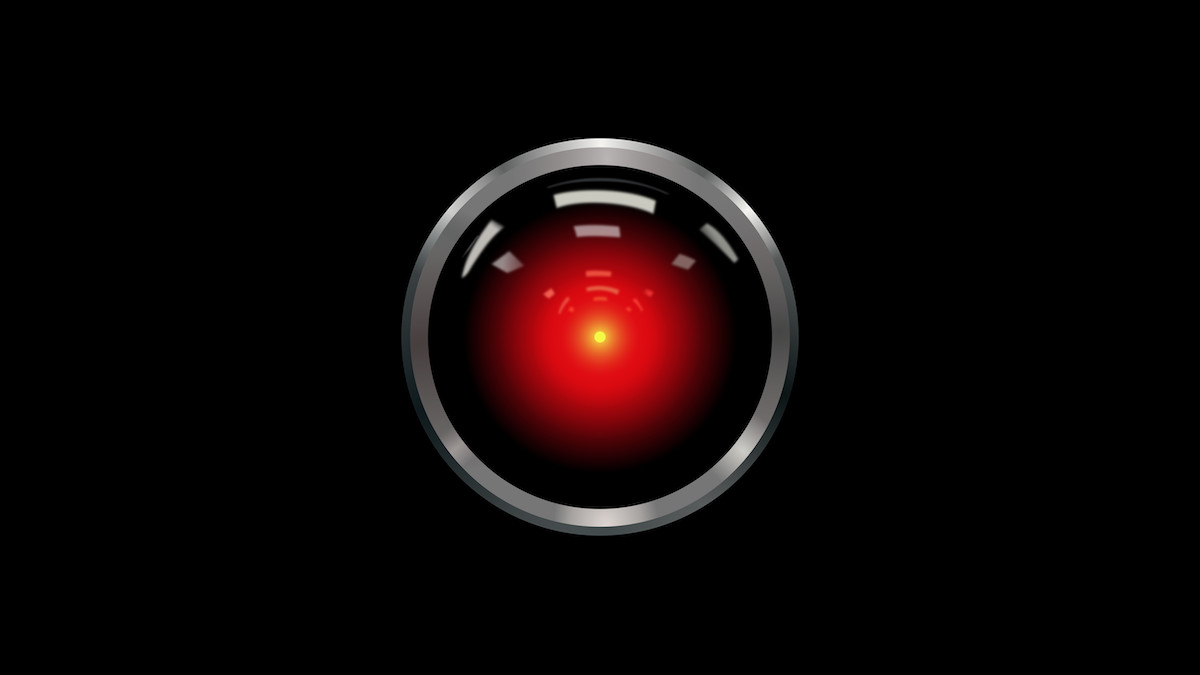

Mythos 5: KI ist objektiv und unvoreingenommen

Dass KI nicht wie ein Mensch denkt, muss kein Nachteil sein. Dann könnten wir die Technik ja als objektive Maschine nutzen. Emotionen sind zwar kein direkter Faktor, aber es ist ein Irrtum zu glauben, dass Algorithmen neutral sind, nur weil sie auf Mathematik und Code basieren. Tatsächlich lernt eine KI aus menschlichen Daten und übernimmt damit natürlich auch unsere Vorurteile, rassistischen Tendenzen und sexistischen Denkmuster. Teilweise werden diese sogar verstärkt. Eine Studie des MIT hat ergeben, dass kommerzielle KI-Systeme klare Vorlieben in Sachen Geschlecht und Hautton haben.