Deepfakes und manipulierte Bilder bedrohen zunehmend demokratische Wahlen – und sind mit bloßem Auge kaum noch zu erkennen. Das Deutsche Forschungszentrum für Künstliche Intelligenz (DFKI) hat deshalb einen KI-Detektor entwickelt, der verdächtige Bilder direkt über Instagram in nur zwei Klicks überprüft.

Die zunehmende Verbreitung von Künstlicher Intelligenz verändert auch die Spielregeln für demokratische Wahlen und birgt dabei auch erhebliche Risiken. Denn KI kann heute täuschend echte Inhalte generieren und so beispielsweise mit Deepfakes von Politikern gezielt Meinungen beeinflussen.

Das große Problem dabei ist, dass diese Inhalte oft kaum noch von echten zu unterscheiden sind. Außerdem verbreiten sie sich über soziale Netzwerke in rasanter Geschwindigkeit.

In den vergangenen Jahren hat sich bereits gezeigt, dass die sogenannten Desinformationskampagnen Wahlprozesse unter Druck setzen und das Vertrauen in demokratische Institutionen untergraben können. Das Deutsche Forschungszentrum für Künstliche Intelligenz (DFKI) hat für die Entlarvung solcher Inhalte nun einen KI-Detektor entwickelt, mit dem Nutzer verdächtige Bilder in nur wenigen Klicks überprüfen lassen können.

Was kann der neue KI-Detektor des DFKI?

Für das Projekt „Check First. Vote Smart“ hat das DFKI mit dem DFKI-Spin-off Gretchen AI und der Landeszentrale für politische Bildung Rheinland-Pfalz zusammengearbeitet. Entstanden ist ein KI-Detektor der verdächtige Bilder, die beispielsweise von Instagram stammen, in nur wenigen Klicks überprüfen kann.

„KI-gesteuerte Bots simulieren gesellschaftliche Mehrheiten, Deepfakes verfälschen Aussagen, ausländische Akteure greifen gezielt in Wahlkämpfe ein“, erklärt Dr. Tobias Wirth, Themenfeldleiter im Forschungsbereich Smarte Daten & Wissensdienste am DFKI Kaiserslautern. „Wir entwickeln KI, die diese Manipulationen aufdeckt – bevor sie verfangen.“

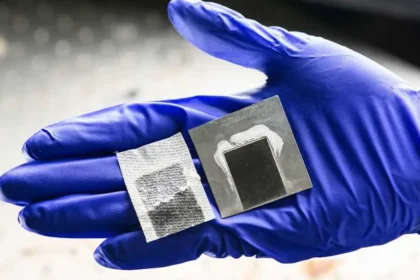

Das entwickelte Tool beschränkt sich bei der Überprüfung jedoch nicht nur auf Pixelartefakte, wie es bei herkömmlichen Ansätzen der Fall ist. Vielmehr werden die forensische Bild- und Audioanalyse mit einer Art „logischem Gegenlesen“ kombiniert.

Denn während das Bild überprüft wird, können KI-Agenten parallel im Internet Parallelen recherchieren und geprüfte Faktenbanken einbeziehen. Hier kommt unter anderem eine enge Kooperation mit dem Faktencheck-Team der dpa zum Tragen.

So prüfst du verdächtige Bilder in zwei Klicks

Hast du einen verdächtigen Post bei Instagram entdeckt, kannst du diesen über die Teilen-Funktion an den Checker-Account „gretchen_ai_berlin“ senden. Von dem KI-Detektor erhältst du dann eine Einschätzung zur Wahrscheinlichkeit eines Fakes und eine kurze Einschätzung zu Einflussfaktoren.

In der Beta-Phase soll der Detektor bereits mehr als 80 verschiedene Manipulationsarten erkennen können. Dies reicht laut dem DFKI von klassischen Deepfake-Videos bis hin zu scheinbar harmlosen Screenshots.

Erkannt werden beispielsweise Eingriffe wie Face-Swaps oder Lip-Sync-Manipulationen. Aber auch Image Splicing, bei dem echte Fotos zu einer irreführenden Szene zusammengesetzt werden, soll der Detektor ausmachen können.

Die Analyse soll ohne zusätzliche App oder Anmeldung besonders niedrigschwellig bleiben. „Wir nutzen ausschließlich Funktionen, die Instagram ohnehin bereitstellt – Direct Message, Teilen, Weiterleiten“, betont das Team, das die Umsetzung DSGVO-konform gestaltet.

Das gilt allerdings nur für die Bildanalyse. Wer auf die Videoanalyse und die Analyse nach früheren Kontexten und Originalmaterial zugreifen will, muss auf die Dashboard Lösung von Gretchen AI zugreifen.

Auch interessant: