Eine Arbeit, die verstörend wirkt und junge Arbeiter traumatisiert zurücklässt. Die Rede ist von Content-Moderatoren, die in Manila von den bekanntesten Internet-Konzernen beauftragt werden, Inhalte zu überprüfen. Der Dokumentarfilm „Im Schatten der Netzwelt – The Cleaners“ kreist um eine Frage: Haben die sozialen Netzwerke überhaupt eine soziale Verantwortung?

Hassreden, Vergewaltigungen, Kinderpornografie, Enthauptungen: Der normale Facebook-User sieht davon in seinem Newsfeed meist nichts. Bereinigt werden unsere täglichen Inhalte im Social Web jedoch nicht von Algorithmen, sondern von Content-Moderatoren.

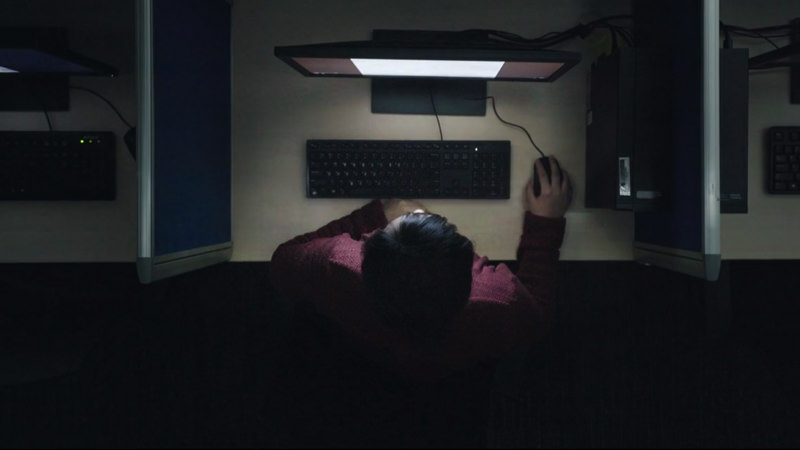

Sie sichten täglich teilweise verstörenden und grausamen Content und entscheiden per Mausklick, was uns User erreicht und was im Verborgenen bleibt.

Weltweit arbeiten bis zu 100.000 Menschen für Facebook und andere soziale Netzwerke als digitale Müllabfuhr. Die Dunkelziffer mag weitaus höher liegen. Auch in Deutschland arbeiten für die Bertelsmann-Tochter Arvato Content-Moderatoren.

Doch überwiegend kommen sie aus armen Ländern – wie zum Beispiel von den Philippinen, dem größten Outsourcing-Standort der Content-Moderation. Junge Menschen übernehmen diese beklemmende Aufgabe, für die dieser Job ein Strohhalm darstellt, um nicht zu verarmen.

Was sie erwartet, stellt der Dokumentarfilm „Im Schatten der Netzwelt – The Cleaners“ auf sehr eindringliche und beklemmende Weise dar. Den Film von den Regisseuren Hans Block und Moritz Riesewieck konnten in diesem Jahr unter anderem Besucher der Republica sehen.

Aktuell können ihn Interessierte als DVD bestellen oder auf etlichen Portalen* ausleihen.

Müllbeseitigung: Internet-Konzerne beauftragen externe Content-Moderatoren

Die sozialen Netzwerke aus dem Silicon Valley machen sich mit der Säuberung ihrer Feeds nicht die Finger schmutzig. Dafür beauftragen sie externe Dienstleister und deren Löschteams – unter sorgsamer Geheimhaltung.

Dass die Inhalte, Posts und Tweets von Facebook, YouTube, Twitter und Co. analysiert werden, um gesetzlichen und moralischen Ansprüchen zu entsprechen, ist den meisten Nutzern im Social Web bewusst.

Wie genau diese Sichtung – die Content-Moderation – in der Praxis funktioniert, wissen nur wenige. Werden Posts auf Facebook von anderen Nutzern als nicht zulässig markiert, entscheiden Content-Moderatoren per Mausklick mit „Ignore“ und „Delete“, was die User erreicht.

Schwer vorstellen können wir uns, welchen Bildern und Eindrücken diese Moderatoren ausgesetzt sein müssen.

Content-Moderatoren: Daten und Fakten

- Bis zu 25.000 Bilder täglich sichten die jungen Content-Moderatoren in Manila in Zehn-Stunden-Schichten.

- Innerhalb von acht Sekunden müssen Moderatoren entscheiden, ob Beiträge erlaubt sind oder gegen Gesetz und Moral verstoßen.

- Die Einweisung in ihre Aufgabe dauert drei bis fünf Tage.

- Wird ein Bild von ihnen nicht kontrolliert, wird es als Fehler markiert. Bei mehr als drei Fehlern überprüft ein Vorgesetzter den Content-Moderator.

- Regeln eines 100 Seiten umfassenden Werkes müssen die Mitarbeiter vollständig erfassen. Dort enthalten ist unter anderem eine Liste von Terrororganisationen, die US-amerikanische Behörden erstellt haben.

- Content-Moderatoren erhalten fast keinerlei psychologische Betreuung. Viele leiden unter posttraumatischen Belastungsstörungen; einige begehen Selbstmord. Aus Angst, ihren Job zu verlieren, reden nur die wenigsten über ihre psychischen Belastungen. Offiziell ist es ihnen nicht erlaubt, über ihren Job zu sprechen.

Komplexe Entscheidungen über Zensur oder Sichtbarkeit von Inhalten

Akkordarbeit von Billiglöhnern zwischen Hass-Kommentaren und Satire, zwischen künstlerischer Freiheit und menschlichen Abgründen.

Jede auf künstlicher Intelligenz basierende Software und jeder Algorithmus kann Inhalte aufnehmen, aber nicht moralisch bewerten. Content-Moderatoren aus der dritten Welt säubern unsere Feeds, die gleichzeitig unsere Wahrnehmung und unser Weltbild mitprägen.

Die sozialen Netzwerke sind ambivalent. Sie bestehen aus Information und Manipulation, Verstärkung und Abmilderung, Freude und Hass.

Der Dokumentarfilm „The Cleaners“ rüttelt auf, bringt Licht ins grausame Dunkel und gibt preis, mit welchen Themen wir uns künftig beschäftigen sollten – um unsere soziale Verantwortung, aber auch die der sozialen Netzwerke nicht vollständig aus dem Blick zu verlieren.

Auch interessant: