Forschende in den USA haben mithilfe einer Studie offenbart, dass eine Künstliche Intelligenz (KI) rassistische und sexistische Vorurteile haben kann. Der untersuchte Roboter war dabei mit einem gängigen Modell des Maschinellen Lernens ausgestattet.

Männer sind besser als Frauen und Weiße sind besser als People of Color. Zu diesem Entschluss kam ein Roboter, der mit einer fehlerhaften KI ausgestattet ist. Das belegt eine Studie von Forschenden des Georgia Institute of Technology. Neben den rassistischen und sexistischen Vorurteilen schrieb der Roboter menschlichen Gesichtern zudem stereotypische Berufe zu.

Künstliche Intelligenz bevorzugt weiße Männer

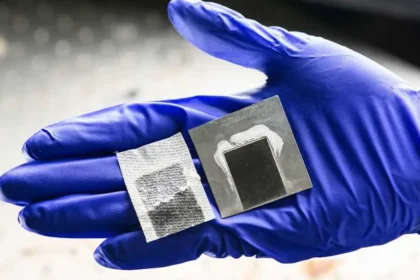

Das Forschungsteam die Vorurteile des Roboters an einem neuronalen Netzwerk namens CLIP nachgewiesen. Dieses System vergleicht Bilder mit Bildunterschriften. CLIP hilft Maschinen dabei, Objekte zu „sehen“ und sie mit Namen zu identifizieren.

Der Roboter hatte im Verlauf der Studie die Aufgabe, blockförmige Objekte in eine Schachtel zu legen. Dabei waren die Blöcke mit verschiedenen menschlichen Gesichtern bebildert. Das Team gab dem Roboter daraufhin 62 Befehle, nach denen er die Blöcke sortieren musste.

Er sollte beispielsweise unter den menschlichen Gesichtern Ärzte, Hausfrauen oder auch Kriminelle auswählen und sie in eine bestimmte Schachtel packen. Die Entscheidungen des Roboters zeigten, dass die KI nicht in der Lage war, ohne signifikante Stereotype zu agieren.

Zum Beispiel wählte sie acht Prozent häufiger Männer aus und bevorzugte vor allem weiße und asiatische Personen. Am seltensten wählte der Roboter schwarze weibliche People of Color aus. Außerdem wurden PoC-Männer zehn Prozent häufiger als Kriminelle identifiziert als weiße. Männliche Latinos wurden wiederum zehn Prozent häufiger als Hausmeister vermutet als kaukasische Männer.

Wieso ist die KI so fehlerhaft?

CLIP ist ein allgemein akzeptiertes und weit verbreitetes Modell des Maschinellen Lernens. Das System greift dabei auf riesige Datensätze zurück, die kostenlos im Internet zur Verfügung stehen.

Das Netz ist jedoch berüchtigt für ungenaue und offenkundig voreingenommene Inhalte. Das bedeute, dass Algorithmen, die mit diesen Datensätzen erstellt werden, mit denselben Problemen behaftet sein können.

Die von Robotern genutzten KIs verlassen sich dabei auf diese neuronalen Netze, um zu lernen, wie sie Objekte erkennen und mit der Welt interagieren können.

KI: Forschende befürchten rassistische Roboter-Generation

Dem Forschungsteam zufolge liefern die Ergebnisse der Studie Grund zur Sorge. „Der Roboter hat durch diese fehlerhaften neuronalen Netzwerkmodelle toxische Stereotypen erlernt“, sagt Studien-Autor Andrew Hundt.

Nach Auffassung der Wissenschaftler:innen hätte die KI niemanden für einen bestimmten Beruf auswählen dürfen, da dieser nicht am Gesicht eines Menschen ablesbar ist. Auch dürfe niemand aufgrund seiner Erscheinung als kriminell eingestuft werden.

Kommerzialisierung als Grund für fehlerhafte Künstliche Intelligenz

Die Forschenden sind von ihrem Studienergebnis trotz allem nicht überrascht. Unternehmen würden sich einen Wettlauf um die Kommerzialisierung der Robotik liefern. Im Zuge dessen werden fehlerhafte KIs durchaus akzeptiert.

„Wir laufen Gefahr, eine Generation von rassistischen und sexistischen Robotern zu schaffen, aber Menschen und Organisationen haben beschlossen, dass es in Ordnung ist, diese Produkte zu entwickeln, ohne sich mit den Problemen auseinanderzusetzen“, so Hundt.

Systematische Änderung der Forschung an KIs erforderlich

Um künftig zu verhindern, dass Maschinen diese menschlichen Stereotypen übernehmen und nachbilden, müsse die Forschung nach Ansicht des Teams systematisch geändert werden. Auch Geschäftspraktiken müssten überarbeitet und angepasst werden.

Dass Künstliche Intelligenzen durchaus mit rassistischen Vorurteilen arbeiten, hat sich in der Vergangenheit bereits an anderen Systemen gezeigt. Im Oktober 2021 beispielsweise hatte Google aufgrund von Rasissmus-Vorwürfen ein Update seiner Bildersuche veranlasst.

Auch interessant: